Difyは、ノーコードでAIアプリケーションを開発できる便利なプラットフォームですが、その中で重要な役割を果たすのが、LLM(大規模言語モデル)のパラメーター設定です。

今回は、DifyでLLMをより効果的に活用するために、知っておくべき主要なパラメーターについて、その意味と設定のコツを詳しく解説します。これらのパラメーターを理解することで、LLMの出力結果をより細かくコントロールし、目的に合ったテキスト生成が可能になると思います。

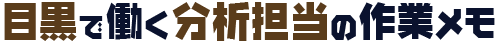

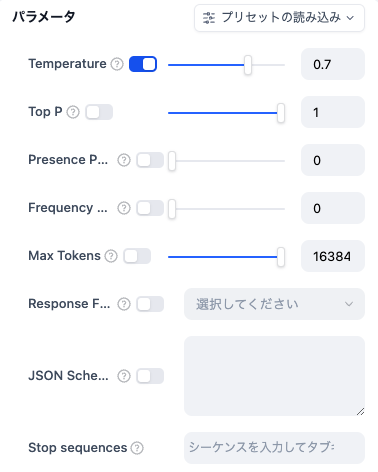

なお、ここで紹介するパラメーターとは、以下LLMブロックのモデルで選択可能なもののことです。

なぜパラメーター設定が重要なのか?

LLMは、与えられた指示に基づいてテキストを生成しますが、その出力は完全に予測可能ではありません。パラメーターを設定することで、LLMの「個性」を調整し、生成されるテキストの創造性、多様性、正確性などをコントロールできます。

例えば、小説のアイデア出しには創造性を高める設定、レポート作成には正確性を重視する設定、といったように、タスクに合わせてパラメーターを調整することで、LLMのポテンシャルを最大限に引き出すことができるのです。

主要なパラメーターとその意味

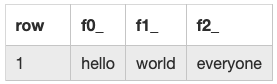

Difyで設定できる主なパラメーターを、以下に表形式でまとめました。各パラメーターの意味、範囲、設定のコツを一覧で確認できます。(2025/1/24時点でのgpt-4o-miniのもの)

| パラメーター | 意味 | 範囲 | 設定のコツ |

| Temperature (温度) | 生成されるテキストのランダムさを調整 | 0〜1 | 0に近いほど予測可能、1に近いほど創造的。タスクに合わせて調整 |

| Top P (トップP) | 生成されるテキストの多様性を制御(累積確率に基づく選択) | 0〜1 | 0に近いほど一貫性、1に近いほど多様性。Temperatureと同時に使用しない方が良い |

| Presence Penalty (プレゼンスペナルティ) | すでに生成された単語やフレーズの繰り返しを抑制 | 0〜1 | 0に近いほど繰り返しやすくなる、1に近いほど抑制 |

| Frequency Penalty (頻度ペナルティ) | 特定の単語の出現頻度に基づいてペナルティを付与 | 0〜1 | 0に近いほど繰り返しやすくなる、1に近いほど抑制 |

| Max Tokens (最大トークン数) | 生成されるテキストの最大トークン数を指定 | 正の整数 | 生成テキストの長さに合わせて調整。LLMの最大トークン数を超えないように注意 |

| Seed (シード) | ランダムなテキスト生成の初期値を指定。同じシード値を使用すると、同じ結果が得られる | 0 または 1 | 同じ生成結果を再現したい場合に利用 |

| response_format (レスポンスフォーマット) | LLMの出力形式を指定(例:JSON) | text, json_object, json_schema | 出力形式を指定したい場合に設定 |

| JSON Schema (JSONスキーマ) | response_formatがjson_objectまたはjson_schemaの場合に、出力するJSONのスキーマを定義 | JSONオブジェクト | 出力するJSONの構造を定義 |

| Stop Sequences (ストップシーケンス) | テキスト生成を終了させる特定の文字列を指定 | 文字列リスト | 特定の区切り文字やフレーズでテキスト生成を終了させたい場合に設定 |

パラメーター設定の注意点

- 最適なパラメーター値は、タスクやLLMの種類によって異なります。

- パラメーターは、実際に試行錯誤しながら調整することが重要です。

- DifyやLLMのアップデートによって、パラメーターの挙動が変わる可能性もあります。

まとめ

LLMのパラメーターは、DifyでAIを活用する上で非常に重要な要素です。この記事で解説したパラメーターを理解し、適切に設定することで、LLMの可能性を最大限に引き出し、より目的に合ったテキスト生成が可能になると思いますので、頑張って調整していきましょう!