「Hugging FaceのAPIを使ってみたいけど、どのモデルが無料なの?」と疑問に思ったことはありませんか?最新のAIモデルをAPI経由で試そうとcurlコマンドを実行したのに、「404 Not Found」という見慣れないエラーに直面した人もいるかもしれません。

このエラーに遭遇したあなたは、きっとこう思ったはずです。

「APIキーは正しいはずなのに、なぜ?ログインが必要なの?それとも何か設定が足りない?」

実は、そのエラーはコマンドや認証の問題ではなく、アクセスしようとしたモデルが無料のAPIでホスティングされていないことに原因があります。Hugging Face Hubには膨大な数のモデルがありますが、すべてが無料でAPI経由で利用できるわけではありません。この記事では、この「Not Found」エラーの謎を解き明かし、無料で推論APIが使えるモデルを確実に見つける方法を解説します。

1. なぜ「Not Found」エラーが出るのか?

curlコマンドでAPIにアクセスした際、https://api-inference.huggingface.co/models/...というURLにリクエストを送ります。

このURLは、Hugging Faceのサーバー上にある「モデルの推論エンドポイント」を指しています。

しかし、もしそのサーバー上に指定されたモデルが存在しない場合、サーバーは「お探しのリソースは見つかりません」という意味で「404 Not Found」を返します。これは、ブラウザで存在しないウェブサイトにアクセスしたときにエラーが出るのと同じ原理です。

例えば、falcon-7b-instructのような大規模モデルは、多くの計算リソースが必要なため、無料で共有されているサーバーには置かれていません。そのため、そのURLは存在しないことになり、エラーが発生するのです。

2. 確実な無料モデルの探し方

無料の推論APIで利用できるモデルを確実に見つけるには、以下の2つの方法があります。

方法1: モデルページのウィジェットを確認する

これが最も確実な方法です。

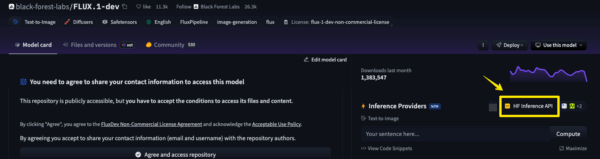

- Hugging Face Hubで、目的のモデルのページにアクセスします。

- ページの右側にある「HF inference API」というウィジェットを確認します。

- このウィジェットが表示されていて、推論を試すための入力フォームがあれば、そのモデルは無料でAPI経由で利用可能です。このウィジェットがない場合、そのモデルは無料APIの対象外です。

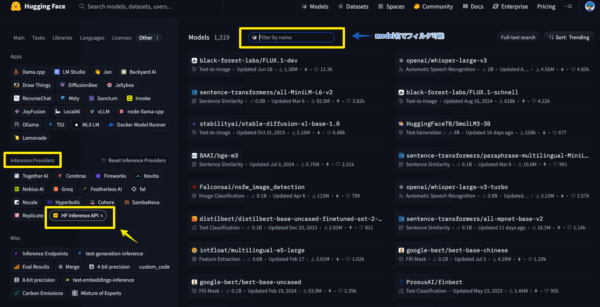

方法2: モデルリストをフィルターする

Hugging Face Hubの検索機能を使って、無料APIでホスティングされているモデルを絞り込むことができます。

- Hugging Faceのモデルページにアクセスします。

- 左側のサイドバーにあるフィルターから「Inference providers」を見つけます。

- 「Hugging Face」というプロバイダーを選択します。

これにより、Hugging Faceが公式に提供する推論APIで利用可能なモデルがリストアップされます。

💡注意点

Hugging Faceのサービスの仕様は常に変更されるため、フィルターの動作が以前と異なる場合があります。そのため、最終確認として方法1でウィジェットを確認することをお勧めします。

3. まとめ

Hugging FaceのAPIを無料で使いたい場合は、闇雲にモデルを試すのではなく、「HF inference API」ウィジェットを確認することが鍵となります。この方法で、どのモデルが無料で利用できるかを正確に判断し、スムーズに開発を進めましょう。